LLMs.txt es un fichero en formato Markdown ubicado en la raíz de tu dominio (tudominio.com/llms.txt) que indica a los modelos de lenguaje cuáles son las páginas más importantes de tu web y cómo interpretar su contenido. Funciona como un mapa del sitio orientado específicamente a modelos de lenguaje, no a buscadores tradicionales.

El estándar fue propuesto en septiembre de 2024 por Jeremy Howard, cofundador de fast.ai y miembro del equipo de Answer.AI. Desde entonces, más de 600 sitios web lo han adoptado, incluyendo Anthropic, Cloudflare y Perplexity. El coste de implementación es mínimo (menos de 1 hora de trabajo) y el riesgo es cero. El potencial, a medida que los modelos de lenguaje incorporen esta señal en sus procesos de rastreo, es significativo.

En esta guía explicamos qué es LLMs.txt, en qué se diferencia de robots.txt y sitemap, cómo crearlo, qué incluir y cuál es su estado de adopción real.

LLMs.txt, robots.txt y sitemap.xml son 3 ficheros con propósitos distintos que conviven en la raíz de un proyecto web. La siguiente tabla resume sus diferencias:

| Dimensión | robots.txt | sitemap.xml | LLMs.txt |

|---|---|---|---|

| Propósito | Indicar qué pueden y qué no pueden rastrear los crawlers | Listar todas las URLs del sitio para facilitar la indexación | Indicar a los modelos de lenguaje cuáles son las páginas clave |

| Audiencia | Googlebot, Bingbot, crawlers de IA | Buscadores tradicionales (Google, Bing) | Modelos de lenguaje (GPT, Claude, Gemini) |

| Formato | Texto plano con directivas (Allow, Disallow) | XML con URLs y metadatos | Markdown con URLs, títulos y descripciones |

| Contenido | Reglas de acceso | Todas las URLs indexables | Selección curada de páginas importantes |

La diferencia clave: el sitemap lista todas las URLs para que el buscador las encuentre. LLMs.txt selecciona las más importantes para que el modelo de lenguaje las priorice. No es un sustituto del sitemap ni del robots.txt: es un complemento orientado a un tipo de consumidor diferente (modelos de IA en lugar de crawlers de búsqueda).

Crear un fichero LLMs.txt requiere 4 pasos y menos de 1 hora de trabajo:

1. Crear el fichero en formato Markdown. El fichero se llama llms.txt y se ubica en la raíz del dominio: tudominio.com/llms.txt.

2. Añadir la cabecera. Nombre del sitio y una descripción breve de 1-2 frases.

3. Listar las páginas clave con URL y descripción. Seleccionar las 10-30 páginas más importantes del sitio (servicios principales, artículos clave, página de contacto) con una línea descriptiva para cada una.

4. Publicar y verificar. Subir el fichero al servidor y comprobar que es accesible en tudominio.com/llms.txt.

Un ejemplo real de estructura:

# thecookies.agency

> Agencia de desarrollo web a medida con Astro, Sanity y Cloudflare.

> Especialistas en rendimiento, diseño y webs preparadas para IA.

## Servicios principales

- [Desarrollo web a medida](https://thecookies.agency/desarrollo-web/): Diseño y desarrollo de proyectos web profesionales con arquitectura headless.

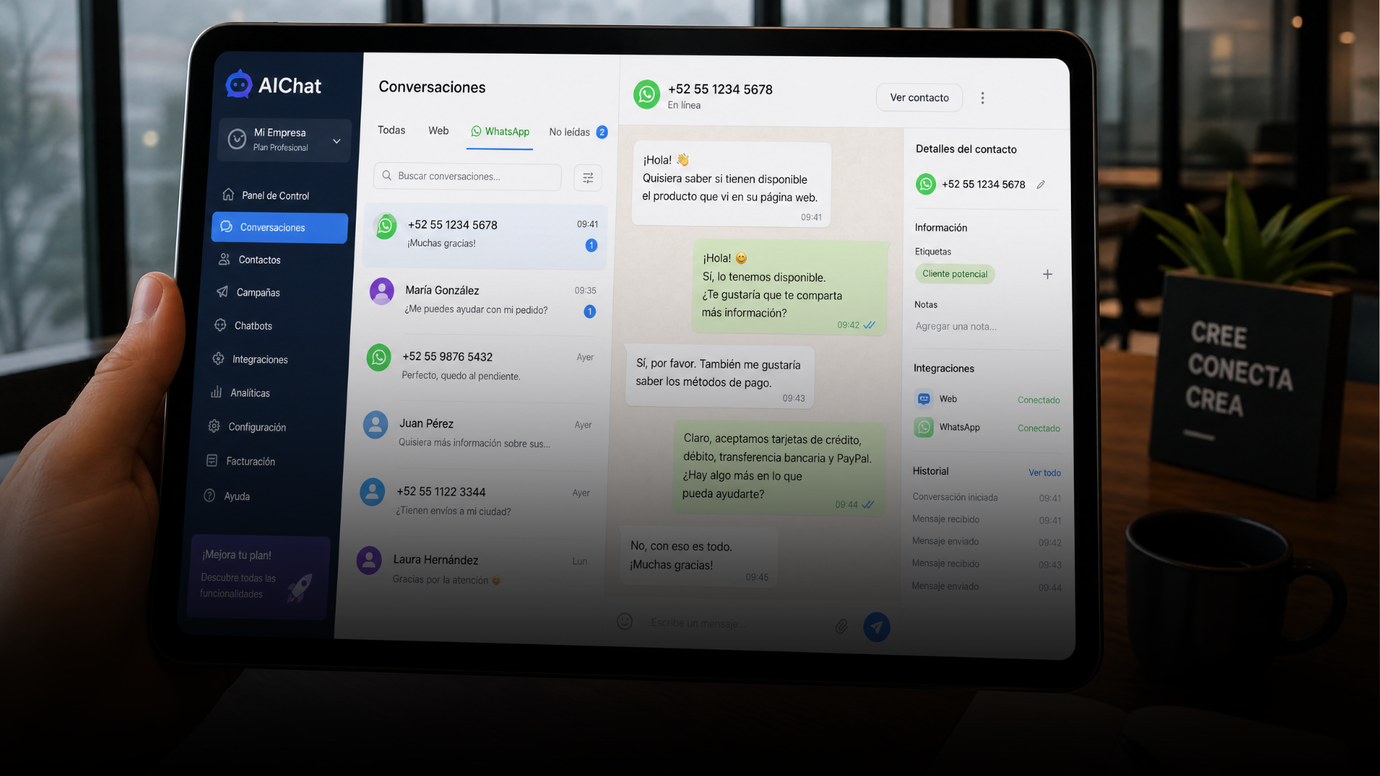

- [IA y automatización](https://thecookies.agency/ia-automatizacion/): Chatbots, automatización de procesos y consultoría de IA para empresas.

## Contenido del blog

- [CMS headless](https://thecookies.agency/blog/cms-headless/): Qué es un CMS headless y por qué cambia la forma de construir webs.

- [Webs preparadas para IA](https://thecookies.agency/blog/webs-preparadas-ia/): Qué significa que una web esté preparada para inteligencia artificial.

Opcionalmente, se puede crear un fichero extendido llms-full.txt que incluya el contenido completo de cada página en Markdown, permitiendo a los modelos acceder a toda la información sin rastrear cada URL individualmente.

LLMs.txt es una selección curada, no un listado completo. El objetivo es que el modelo de lenguaje identifique rápidamente qué ofrece tu web y cuáles son las páginas más relevantes.

Lo que SÍ incluir: páginas de servicios principales, artículos de blog que definen los temas clave del negocio, página de contacto, página "sobre nosotros" y cualquier recurso que un modelo pueda necesitar para entender qué hace tu empresa y por qué es una fuente fiable.

Lo que NO incluir: todas las URLs del sitio (eso es el sitemap), páginas de política de privacidad o cookies (no aportan contexto de negocio), páginas de paginación del blog, URLs con parámetros dinámicos ni páginas en construcción.

La regla práctica: si un modelo de lenguaje solo pudiera leer 20 páginas de tu web para entender tu negocio, ¿cuáles serían? Esas son las que van en LLMs.txt.

Este fichero es uno de los 5 elementos de una web preparada para inteligencia artificial. Si quieres entender cómo encaja con el resto (schema, contenido dual, MCP, monitorización), lo explicamos en el artículo sobre elementos de una web preparada para inteligencia artificial.

LLMs.txt ha sido adoptado por más de 600 sitios web desde septiembre de 2024. Entre los adoptantes más relevantes están Anthropic (anthropic.com), Cloudflare (cloudflare.com), Perplexity (perplexity.ai), varias universidades y cientos de sitios de documentación técnica.

El impacto medible es todavía limitado. Ningún buscador generativo ha confirmado públicamente que use LLMs.txt como señal de ranking o como fuente prioritaria de rastreo. Los estudios disponibles (Otterly.ai, SE Ranking) muestran correlaciones positivas pero no causalidad directa entre tener LLMs.txt y ser citado por buscadores generativos.

Lo que sí es verificable: los crawlers de IA (GPTBot, ClaudeBot) acceden al fichero LLMs.txt cuando está disponible. Esto indica que los sistemas lo detectan y lo procesan, aunque el impacto en las citaciones no está cuantificado de forma definitiva.

Sí, por 3 razones: bajo coste, bajo riesgo y alto potencial. Crear un LLMs.txt cuesta menos de 1 hora de trabajo. No tiene efectos negativos sobre el SEO ni sobre la experiencia de usuario. Y posiciona al proyecto web en la primera línea de adopción de un estándar que los modelos de lenguaje probablemente incorporarán como señal a medida que madure.

Los argumentos a favor: el coste es irrelevante, la tendencia de adopción es creciente, los sitios más relevantes del ecosistema de IA ya lo implementan y el fichero facilita que los modelos comprendan tu web con menos esfuerzo.

Los argumentos en contra: no hay impacto demostrado en rankings generativos, el estándar no tiene gobernanza formal (es una propuesta de Jeremy Howard, no un RFC) y la mayoría de modelos rastrean webs sin necesitar LLMs.txt.

La recomendación: implementarlo hoy y monitorizarlo. Si en 12 meses se convierte en señal relevante, ya lo tienes. Si no, has invertido 1 hora.

No directamente. Google no ha indicado que LLMs.txt sea un factor de posicionamiento en la búsqueda tradicional. Su propósito es la visibilidad ante modelos de lenguaje, no ante Googlebot.

Donde sí puede tener impacto es en la visibilidad en buscadores generativos: Gemini (Google), ChatGPT (OpenAI), Perplexity y Claude procesan este fichero cuando existe. Si esa visibilidad se traduce en más citaciones y más tráfico de referencia desde buscadores generativos, el impacto indirecto en el negocio es real. Si quieres entender cómo funciona esta disciplina, lo explicamos en el artículo sobre optimización para buscadores generativos.

LLMs.txt es un fichero de texto que cuesta 1 hora de trabajo y posiciona tu proyecto web en el punto donde la visibilidad para modelos de lenguaje se está construyendo. No es la bala de plata que va a transformar tu tráfico mañana. Es la señal que indica a las máquinas que tu web está preparada para hablar su idioma. Y las señales que se envían primero son las que se procesan primero cuando el ecosistema las necesita.

También te puede gustar

000 THECOOKIES Terminal v1.0

Escribe tu email para iniciar una conversación con nuestro asistente de IA.

────────────────────────────────────────────────────────